ChatGPT, utviklet av OpenAI, introduserer nye funksjoner som lar deg samhandle gjennom stemme og bilder, og tilbyr et intuitivt grensesnitt og flere måter å integrere ChatGPT i ditt daglige liv. I en nylig kunngjøring på nettsiden sin bestemte OpenAI seg for å avsløre disse nye funksjonene på forhånd. På samme måte fremhevet han også fordelene de gir og utfordringene de gir i det voksende AI-markedet.

Emner i denne artikkelen:

ChatGPT: stemmeinteraksjon

Med den nye stemmefunksjonaliteten kan brukerne ha interaktive samtaler med ChatGPT. Dette lar deg bruke assistenten selv på farten, noe som øker potensialet til chatboten. En bruker kan for eksempel be ChatGPT om å fortelle en barnehistorie mens han er på farten, noe som gjør det morsommere.

Eller, under en middag med venner, kan en debatt om et spesifikt tema dukke opp; i dette tilfellet kan brukere bruke boten for å få nøyaktig informasjon og løse debatten på en konstruktiv måte.

ChatGPTs stemmeteknologi bruker en avansert tekst-til-tale-modell. I samarbeid med profesjonelle stemmeskuespillere er denne modellen i stand til å generere humanoid lyd fra tekst og korte stemmeprøver, noe som gjør interaksjonen med ChatGPT enda mer naturlig og intuitiv. Også takket være Hviske, et åpen kildekode talegjenkjenningssystem utviklet av OpenAI, er talte ord transkribert til tekst med stor presisjon, slik at chatboten kan forstå og svare effektivt på brukerforespørsler.

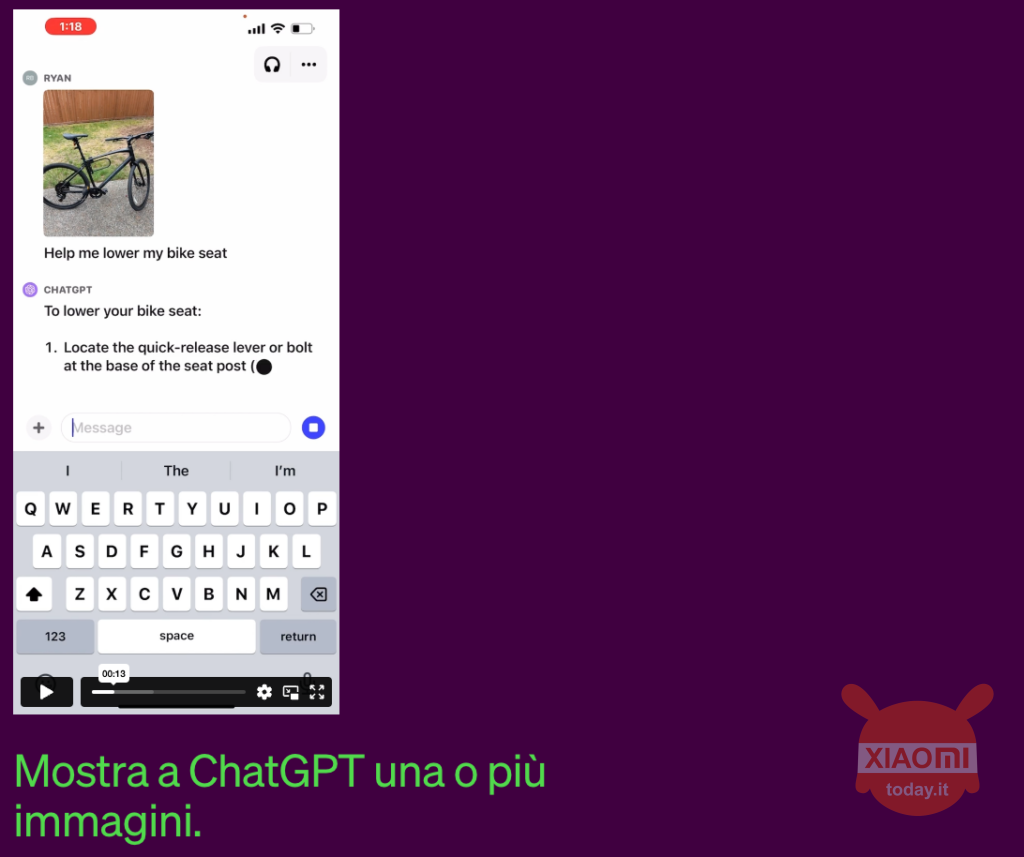

ChatGPT: visuell interaksjon

Som ovenfor kan AI-modellen nå analysere ett eller flere bilder, som lar brukere løse problemer, planlegge måltider eller analysere komplekse grafer. En bruker kan for eksempel sende inn et bilde av innholdet i kjøleskapet sitt. Chatboten bør derfor brukes analyser maten som finnes og foreslå oppskrifter basert på disse ingrediensene, gir også trinnvise instruksjoner for forberedelse.

Les også: GPT-4: Gemini blir Googles rival. Her er forskjellene

Videre, hvis brukeren trenger å fokusere på et bestemt element i bildet, ChatGPTs mobilapp inkluderer et tegneverktøy som lar deg fremheve bestemte områder av bildet, noe som gjør kommunikasjon og analyse enda mer presis og personlig.

Bildeforståelse er drevet av GPT-3.5 og GPT-4 multimodale modeller. Disse avanserte modellene de bruker språkkunnskapene sine på et bredt spekter av bilder, som fotografier, skjermbilder og dokumenter som inneholder både tekst og bilder, slik at ChatGPT kan forstå og tolke den visuelle konteksten nøyaktig og i detalj.

Det er verdt å nevne at fra poco OpenAI har integrert ikke bare det Lerret men også DALL-E 3 i ChatGPT, eller den generative bildemodellen.

Når og for hvem vil det være tilgjengelig

I løpet av de neste to ukene vil OpenAI implementere tale og bilder i ChatGPT for brukere brukere med Plus- og Enterprise-abonnement.

Funksjonen som tillater stemmeinteraksjon vil være tilgjengelig på iOS og Android men ikke på nettversjonen, som er den som brukes av folk flest.

Funksjonen som tillater visuell interaksjon vil være tilgjengelig i stedet på alle plattformer, derfor Android, iOS og web.

Kilde | OpenAI